基于OGG 21c圖形化實現9TB數據從Oracle 11g到19c的不停機遷移(上篇)——微服務架構詳解與部署、同步問題總覽

在當今企業級數據管理中,數據庫的升級與遷移是保障系統性能、安全性與可擴展性的關鍵環節。面對海量數據(如9TB)和7x24小時不間斷的業務需求,如何實現平滑、高效、零宕機的數據遷移成為技術挑戰。本系列文章將分三篇,詳細闡述如何利用Oracle GoldenGate (OGG) 21c的全程圖形化界面,完成從Oracle 11g到19c的大規模數據遷移。本文作為首篇,將聚焦于整體方案中的微服務架構設計、數據處理服務的部署,以及對遷移過程中可能遇到的同步問題進行總覽。

一、項目背景與挑戰

本次遷移的核心目標是:將9TB的業務數據從老舊的Oracle 11g數據庫,在線遷移至性能更優、功能更強的Oracle 19c,且要求在整個過程中,源端11g數據庫始終保持對外服務,實現真正的“零停機”或“近零停機”遷移。主要挑戰包括:

- 數據量巨大:9TB數據量對遷移效率、網絡帶寬和存儲I/O構成壓力。

- 業務連續性要求高:源庫需持續提供服務,任何中斷都可能影響核心業務。

- 版本跨度大:從11g到19c存在多個版本的差異,需確保數據類型的兼容性與業務邏輯的一致性。

- 架構復雜性:現代應用往往采用微服務架構,數據遷移需與分布式服務部署協調進行。

二、OGG 21c圖形化方案優勢

Oracle GoldenGate 21c作為成熟的數據復制與集成工具,其全新的圖形化管理界面(如Oracle GoldenGate Microservices Architecture)為本項目提供了極大便利:

- 可視化操作:通過Web瀏覽器即可完成絕大部分配置、監控和管理任務,降低了命令行操作的復雜度和出錯風險。

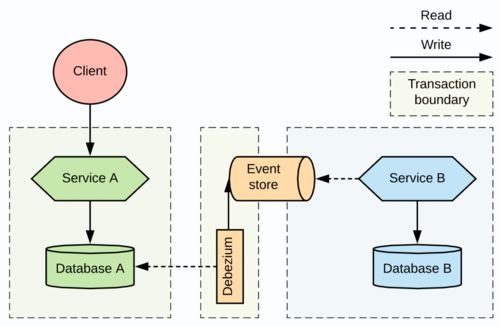

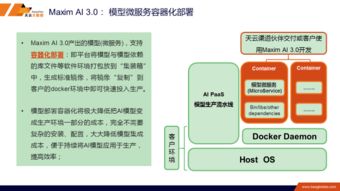

- 微服務架構:OGG 21c自身采用微服務架構,服務(如管理服務、分發服務、接收服務等)可獨立部署、擴展和治理,與本次遷移目標系統的微服務化理念高度契合。

- 高性能與低延遲:基于日志的CDC(變化數據捕獲)技術,能夠以極低的延遲實時同步數據變更,確保目標端與源端的數據最終一致性。

- 異構平臺支持:為未來可能的跨平臺數據同步預留了能力。

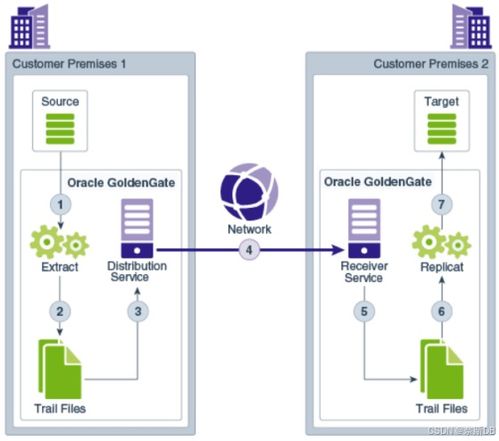

三、微服務架構下的數據處理服務詳解

在本遷移項目中,“數據處理服務”并非指業務微服務,而是特指為完成數據遷移與同步而構建的一組OGG微服務及輔助服務。它們共同構成了遷移管道的核心。

1. 核心OGG微服務組件:

- 管理服務 (Administration Service):遷移任務的“大腦”。通過其圖形化控制臺,我們可以創建、配置、啟動和監控整個OGG環境下的所有進程(抽取Extract、投遞Pump、復制Replicat)。

- 分發服務 (Distribution Service):負責將捕獲到的數據變更(trail文件)從源端安全、高效地傳輸到目標端。在圖形化界面中,可以輕松配置路由和加密。

- 接收服務 (Receiver Service):部署在目標端,用于接收來自源端的變更數據流,并寫入本地的trail文件。

- 性能度量服務 (Performance Metrics Service):提供實時監控面板,可視化展示吞吐量、延遲、檢查點等關鍵指標,是保障9TB數據平穩遷移的“儀表盤”。

2. 輔助服務與架構考量:

- 配置存儲庫:使用Oracle數據庫或兼容的數據庫存儲OGG的配置元數據,實現配置的集中化管理和高可用。

- 服務發現與網絡:在容器化(如Kubernetes)或虛擬機環境中,需妥善處理這些微服務間的網絡通信、服務發現和負載均衡。

- 數據處理服務集群:針對9TB的數據量,可以對抽取(Extract)和復制(Replicat)進程進行并行化配置,即部署多個進程處理不同表或表分區的數據,形成數據處理集群,大幅提升遷移速度。

四、微服務部署流程概要

- 環境準備:在源端(11g)和目標端(19c)服務器上分別安裝OGG 21c微服務架構軟件。確保網絡互通,防火墻開放相關端口(如管理服務的443端口)。

- 創建部署:通過OGG安裝程序,分別創建源端和目標端的“部署”(Deployment)。一個部署包含了一組完整的微服務實例。

- 配置服務:通過瀏覽器訪問各端的管理服務控制臺(https://hostname:port),進行初始化配置,包括創建憑證庫、注冊數據庫連接信息等。

- 配置核心進程:

- 源端:創建初始數據加載的抽取進程(Initial Load Extract),以及用于持續同步的抽取進程和投遞進程(Pump)。

- 目標端:創建用于初始加載的復制進程,以及用于持續同步的復制進程。

- 集成與測試:將OGG數據處理服務與現有的應用微服務環境進行集成測試,確保數據流不干擾正常業務。

五、同步問題總覽

在如此大規模的實時同步中,預見并規避潛在問題是成功的關鍵。主要同步問題可分為以下幾類:

- 數據一致性問題:

- 初始加載與增量同步的銜接:如何在初始全量數據導出/導入期間產生的增量變更不丟失,平滑銜接后續的實時同步。解決方案是使用OGG的“集成捕獲”模式配合SCN號進行精確切換。

- 沖突檢測與解決:在雙向同步或目標端有寫操作時(本例是單向,但需預防),可能出現數據沖突。需在復制進程上配置沖突檢測與解決規則。

- 性能與延遲問題:

- 大表與LOB字段:9TB數據中可能包含大量CLOB/BLOB字段或超大規模表,這些會嚴重影響抽取和復制速度。需要采用特殊參數優化(如

FETCHOPTIONS, 使用并行處理)。

- 網絡帶寬與穩定性:跨機房或長距離傳輸9TB數據及后續增量,對網絡要求極高。需啟用壓縮,并規劃好分發服務的吞吐量。

- 目標端寫入性能:目標19c數據庫的I/O能力需滿足實時寫入要求,避免成為瓶頸。

- 運維監控問題:

- 進程異常與自動重啟:如何監控數百個OGG進程的狀態,并實現故障自動恢復。這需要結合OGG性能度量服務的告警功能和外部運維腳本。

- 數據校驗:遷移完成后,如何高效驗證9TB數據在源端和目標端的一致性。除OGG自帶的報告外,可能需要額外的校驗工具或定制化比對任務。

- 架構與業務適配問題:

- 微服務調用依賴:當部分表數據已遷移至19c,而相關微服務仍在連接11g時,可能導致數據訪問不一致。這需要精細的“應用割接”計劃,而非簡單的數據遷移。

- DDL變更同步:在長達數周甚至數月的遷移周期內,源庫可能發生表結構變更(DDL)。OGG對DDL的支持需要謹慎評估和額外配置。

###

本篇作為系列文章的開篇,系統性地介紹了利用OGG 21c圖形化工具進行大規模、不停機數據遷移的整體思路,并重點剖析了支撐該任務的微服務化“數據處理服務”架構,以及需要全局考量的同步問題。通過清晰的架構設計和前瞻性的問題總覽,為后續中篇(詳細配置與初始加載實戰)和下篇(增量同步切換與驗證)奠定了堅實的理論基礎和規劃指導。在下一篇文章中,我們將深入圖形化控制臺,一步步演示如何配置和啟動這9TB數據的初始加載任務。

如若轉載,請注明出處:http://www.qiye169.cn/product/74.html

更新時間:2026-04-14 04:13:56